Hace ya unos cuantos años que el periodismo se embarcó en una lucha de la que no tenía forma de salir bien parado, pero en la que de todas formas se embarcó. Voluntariamente aceptó ser parte del abanico de las opciones del entretenimiento, sumándose a la disputa, en un plano de igualdad, con la programación televisiva, el cine, la música, luego internet y las redes sociales.

No era, originalmente, el cometido del periodismo “entretener”, por más que el buen periodismo fuese interesante y hasta considerado una rama de la Literatura, se reservaba un espacio diferente, porque en las democracias del mundo el periodismo solía tener (y todavía tiene, aunque no se ejerza del todo) otra función, con mucha discusión y debate entorno a ella por cierto, aquello del “quinto poder”. El periodismo (en todos sus formatos, no importa) aceptó que esa aura de “necesario”, esa supuesta obligación social o moral de los ciudadanos por consumirlo le daría una posición de ventaja frente a otras alternativas del espectro del espectáculo, al que se sumó, dando lugar a una larga variedad de propuestas (en todos los formatos) que más que apartarse de aquellos postulados originales daban la impresión de estar sumando otras herramientas. Pero lentamente, en el mundo, el periodismo se volvió una faceta más del entretenimiento, ingresó en una disputa por el tiempo de atención del público, y en el proceso perdió toda aquella aura de “consumo necesario”. El público podía elegir “perderse” las noticias, o asumir que simplemente se enteraría de alguna manera de las cosas verdaderamente relevantes. En ese proceso perdió el periodismo, por supuesto, pero perdió también la sociedad toda, entendemos.

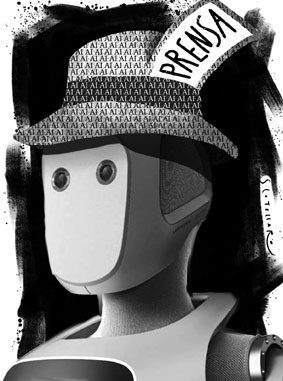

Pero como si esto fuera poco ese mismo periodismo, ya obligado a dar esa pelea en condiciones desiguales, hoy además afronta el riesgo de que herramientas que pueden dar una gran mano en la generación y en el procesamiento de noticias, pueden a la vez estar socavando el último gran pilar que le queda a los medios de comunicación informativos, que es el de la credibilidad, el de la confianza. Porque en pos de otros méritos, como la rapidez o la espectacularidad, o de otros artificios pensados para captar lectores, o ni siquiera, para simplemente captar clicks, ha empezado a delegar tareas que solían ser artesanales, como la redacción de un artículo, a manos de chatbots de inteligencia artificial. Y ojo, no se trata de desconocer la relevancia de la herramienta que está cambiando el mundo, que ha abierto la posibilidad de procesar e interpretar volúmenes de datos como nunca soñó la humanidad. Para ello, claro, es necesario contar con personas que sepan dar las instrucciones adecuadas, ayudar a determinar las fuentes, luego hacer una validación y finalmente presentarlo como un producto ideal para el público. Si, en vez de ello, solamente se pide generar una nota, sin más, dejando a la inteligencia artificial encargarse de todo, seguramente el resultado no sea el óptimo.

Esto ocurrió en un diario de los más prestigiosos de América Latina, como El Espectador, de Colombia, donde un pasante empleó irresponsablemente una herramienta de inteligencia artificial para inventar fuentes y citas de expertos y universidades igualmente falsas. Esto ocurrió durante algunos meses antes que se pudiera detectar el fraude y se eliminaran todos los artículos realizados por el fraudulento trabajador.

Fallaron todos los filtros de los editores, como reconoció el propio director de El Espectador, Fidel Cano, en una columna en video que periódicamente publica en YouTube, donde suele comentar yerros de la redacción y hacer el mea culpa de cada caso (ver QR). En esta oportunidad no se trataba de una política de la empresa sino de la obra de un empleado infiel que no puso en jaque la confiabilidad de una de las empresas periodísticas referentes del continente, pero que sin lugar a dudas generó más de un dolor de cabeza y preocupación por lo que se viene. Y es que justamente lo que se viene es como para alarmarse. La Sociedad Interamericana de Prensa (SIP) organiza un Ciclo de Diálogo sobre inteligencia artificial y medios, y en la primera instancia de este se abordó, además del referido caso de El Espectador, el uso problemático de la herramienta en el periodismo y el desafío que supone para las empresas periodísticas, pero también para las academias, en la medida que los estudiantes llegan ya con el uso incorporado de estos recursos, resignando otras virtudes. Se “descansan” en la máquina, dejando de lado toda una parte sustancial que es en la que tradicionalmente ha consistido este oficio, que es la de aproximarse a los problemas, entender la situación y el punto de vista de las personas, cotejarlo, y desde allí elaborar un producto periodístico que presentar al público. Usando mal la inteligencia artificial se puede suplir cualquiera de estas partes del proceso, y en cualquiera de ellas algo puede salir mal, aun sin llegar al caso extremo de Colombia, en el que evidentemente hubo, además, mala intención.

Se citaba en este primer encuentro del ciclo el concepto de “deuda cognitiva”, desarrollado por la investigadora Nataliya Kosmyna, del MIT de Estados Unidos, quien presentó el año pasado un estudio titulado “Tu cerebro en Chat GPT” (Your Brain on chat GPT), en el que demostró que la deuda cognitiva, más que una sensación de pereza, es un fenómeno físico “medible en el cerebro”. Para el estudio pidió a dos grupos de estudiantes elaborar un ensayo, a uno de los grupos permitió utilizar el chatbot. El 83% de quienes emplearon la inteligencia artificial no pudieron recordar ni una sola frase del escrito apenas unos minutos después de terminar. En el otro grupo el fallo de memoria fue de apenas el 11%. Pero más allá de esto, que puede percibirse como problemático por sus efectos en el largo plazo, en el encuentro se enumeraron otros efectos derivados del mal uso de estas herramientas, como la pérdida de una voz propia, de estilo personal y de la capacidad de estructurar argumentos lógicos desde cero; pero también la incapacidad de navegar bases de datos complejas o de discernir la calidad y el contexto de las fuentes originales; lo mismo con la delegación de decisiones y dilemas a la lógica del algoritmo, lo que erosiona la responsabilidad moral y la capacidad de tomar decisiones difíciles bajo presión. Cuando esto pasa a quienes deberían “apoyarse” en el uso de estas herramientas y en lugar de ello las emplean para autosustituirse, haciendo omisión de sus responsabilidades, el resultado es un periodismo menos interesante, menos humano y además menos preciso.